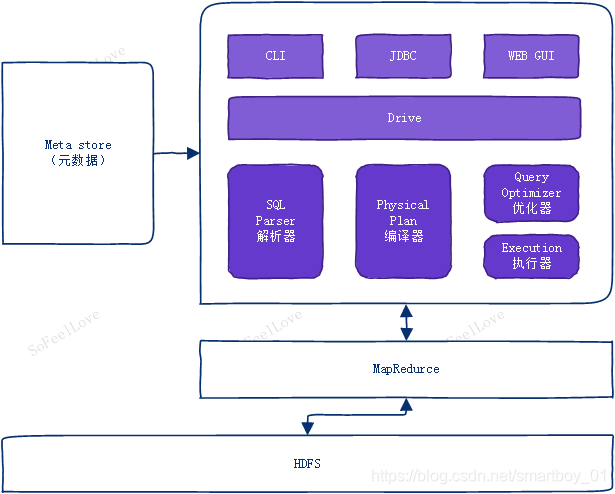

Hive架构原理

架构图

Hive通过用户提供的一系列交互接口,接收到用户的指令(SQL)- 使用自己的

Driver,结合元数据(MetaStore),将这些指令翻译成MapReduce,提交到Hadoop中执行 - 最后,将执行返回的结果输出到用户交互接口

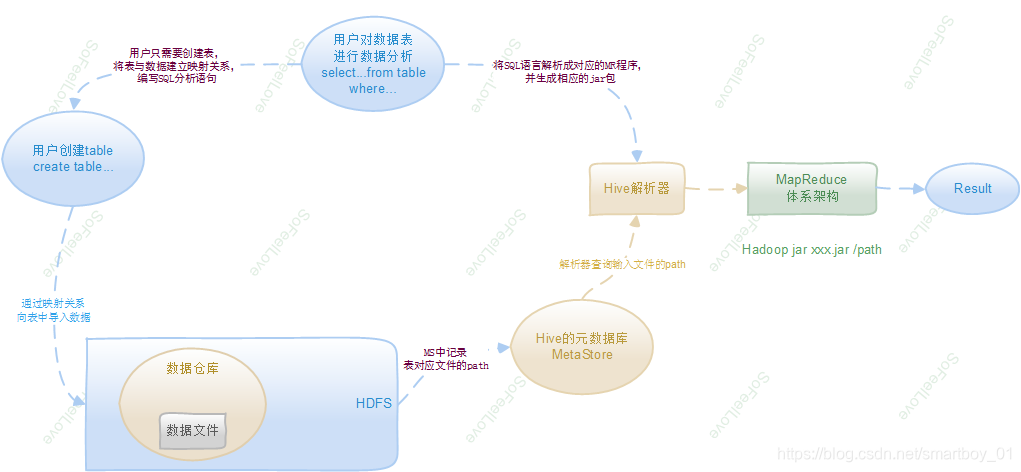

运行机制

详细执行步骤

- 用户接口:

Client CLI(hive shell命令行),JDBC/ODBC(java访问hive),WEB GUI(浏览器访问hive) - 元数据:

Metastore

元数据包括:表名,表所属数据库(默认是default) ,表的拥有者,列/分区字段,表的类型(是否是外部表),表的数据所在目录等。

默认存储在自带的derby数据库中,推荐使用MySQL存储Metastore hive使用HDFS进行存储,使用MapReduce进行计算- 驱动器:

Driver- 解析器(

SQL Parser)

将SQL字符转换成抽象语法树AST,这一步一般使用都是第三方工具库完成,比如antlr,对AST进行语法分析,比如表是否存在,字段是否存在,SQL语句是否有误 - 编译器(

Physical Plan):将AST编译生成逻辑执行计划 - 优化器(

Query Optimizer):对逻辑执行计划进行优化 - 执行器(

Execution):把逻辑执行计划转换成可以运行的物理计划,对于Hive来说,就是MR/Spark

- 解析器(

来源:CSDN

作者:SoFeelLove

链接:https://blog.csdn.net/smartboy_01/article/details/103702727